Risiken Künstlicher Intelligenz

Alexander Saheb

Künstliche Intelligenz: Vielerorts setzt man darauf grosse Hoffnungen. Die Studie "The Rise of Artificial Intelligence: Future Outlook and Emerging Risks" von Allianz Global Corporate & Specialty (AGCS) thematisiert jedoch auch die Gefahren der Künstlichen Intelligenz. Demnach erhöht der Einsatz Künstlicher Intelligenz (KI) das Risiko für Grossschäden durch Cyberangriffe und technisches Versagen, gelangt sie in falsche Hände.

Künstliche Intelligenz birgt vielschichtige Risiken

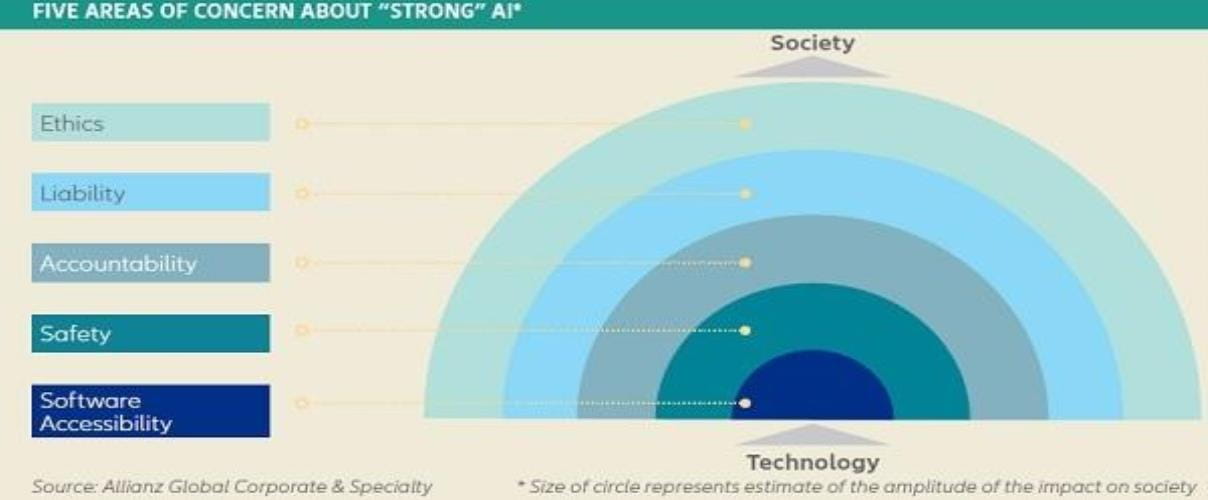

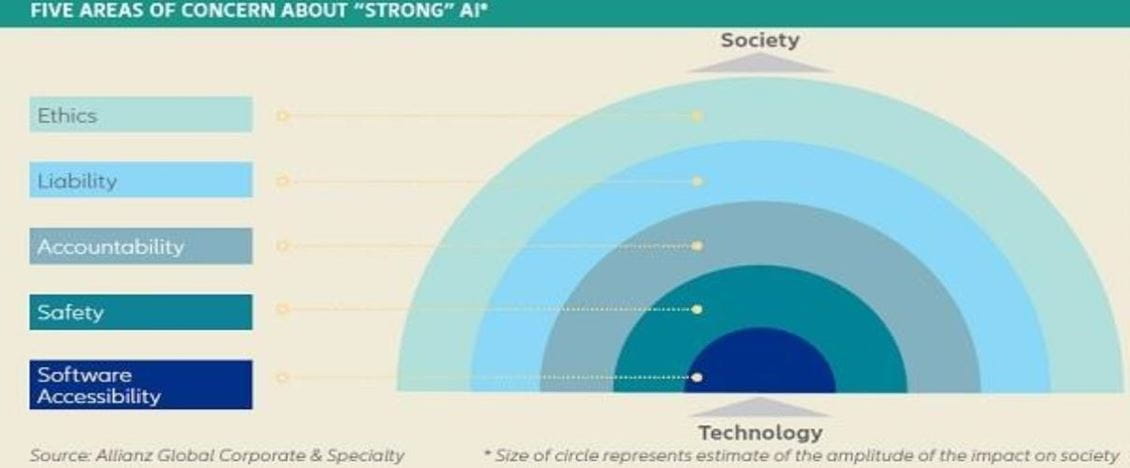

Die AGCS stellt fünf Themenkreise ins Zentrum (siehe Grafik): Es sind Softwareverfügbarkeit, Sicherheit, Verantwortlichkeit, Haftung und Ethik.

- Softwareverfügbarkeit: Sollte KI-Softwarecode öffentlich zugänglich sein oder nicht? Es gibt für beide Varianten gute Gründe, aber auch Argumente, die dagegen sprechen. Wenn die Software für Künstliche Intelligenz frei verfügbar ist, dürfte sich die Entwicklung beschleunigen. Dies birgt allerdings auch das Risiko des Missbrauchs mit nicht abschätzbaren Konsequenzen.

- Sicherheit: Das Rennen um die schnelle Markteinführung von Künstliche Intelligenz-Systemen könnte dazu führen, dass Überprüfungen nur unzureichend durchgeführt werden und so keine sicheren und funktionalen KI-Anwendungen gewährleistet sind. Dies könnte wiederum mehr Produktmängel und -rückrufe auslösen.

- Verantwortlichkeit: Wie können die Entscheidungen von KI-Systemen von berechtigten Personenkreisen nachvollzogen werden? Regulatoren möchten nicht nur den Dateninput und das Ergebnis begutachten können, sondern den Verarbeitungsprozess des KI-Agenten selbst. Transparenz bedeutet hier das Recht zu wissen, wie ein KI-System zu einer Entscheidung gekommen ist. Schon heute tendieren lernende Chatbots dazu, menschliche Vorurteile und Präferenzen unreflektiert zu übernehmen.

- Haftung: Intelligente KI-Agenten können dem Menschen viele Entscheidungen abnehmen, dafür aber rechtlich nicht zur Verantwortung gezogen werden. In der Regel haftet der Hersteller oder Softwareprogrammierer von KI-Agenten für Fehler, die bei Nutzern Schäden verursachen. Für auf KI basierende Entscheidungen, die sich nicht direkt auf das Design oder die Herstellung zurückführen lassen, die aber von einem KI-Agenten aufgrund seiner Interpretation der Realität getroffen werden, könnte nach aktuell geltendem Recht allerdings niemand explizit haftbar gemacht werden. Die Allianz-Experten verlangen einen Haftungsrahmen, der Designer, Hersteller oder Verkäufer von KI-Produkten einer beschränkten Delikthaftung aussetzt.

- Ethik: Entscheidungen durch eine Künstliche Intelligenz sind gerade im dynamischen und komplexen Kontexte oft schneller, genauer und passender als menschliche. Dennoch fehlt der KI ein handlungsleitender Rahmen, der sich an menschlichen Wertvorstellungen orientiert. Konzepte wie Glück, Loyalität, Schmerz oder Werte können nicht in Programmcode ausgedrückt werden. Eine KI könnte deshalb auch Entscheidungen treffen, die menschlichen Interessen zuwiderlaufen. Ein Beispiel: Eine auf maximales Wohlbefinden der Patientin trainierte KI betreut eine Person mit Parkinson. Um das Risiko von Stürzen zu senken, begrenzt die KI die Möglichkeiten zu Verlassen des eigenen Apartments. Das führt allerdings zu weniger sozialen Kontakten und zieht eine Depression der Person nach sich.